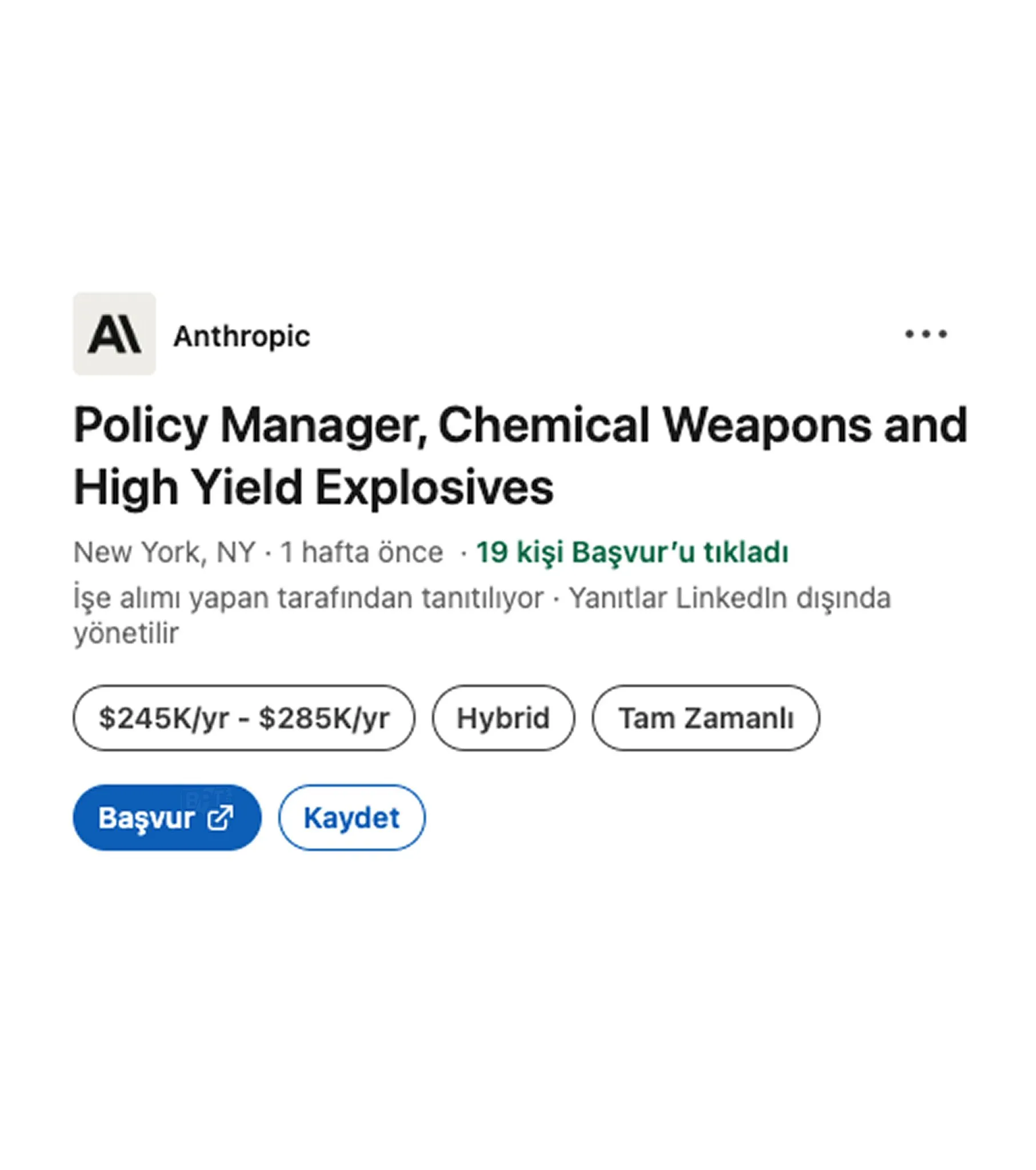

Anthropic’ten Sıra Dışı İlan: 12 Milyon TL Maaşla Kimyasal Silah Uzmanı Aranıyor

Yapay zeka güvenliği konusundaki hassasiyetiyle bilinen ve Claude modelinin geliştiricisi olan Anthropic, teknoloji dünyasında eşine az rastlanır bir iş ilanı yayınladı. Şirket, yapay zeka modellerinin biyolojik ve kimyasal silah yapımında kötüye kullanılmasını engellemek amacıyla, bu alanlarda derin tecrübeye sahip profesyoneller arıyor. Sunulan yıllık 285.000 dolarlık (yaklaşık 12.500.000 TL) maaş ise pozisyonun kritikliğini gözler önüne seriyor.

Pozisyonun Amacı: "Felaket Senaryolarını" Engellemek

"Politika Yöneticisi, Kimyasal Silahlar ve Yüksek Tahrip Güçlü Patlayıcılar" (Policy Manager, Chemical Weapons and High Yield Explosives) başlığıyla duyurulan bu pozisyon, aslında Anthropic'in Güvenlik (Safeguards) ekibi için kilit bir rol üstleniyor. Temel amaç, Claude gibi gelişmiş yapay zeka modellerinin, kötü niyetli kişiler tarafından kimyasal silah sentezlemek veya patlayıcı düzenekleri hazırlamak için bir rehber olarak kullanılmasını kesin bir şekilde engellemek.

Adaylardan Beklenen Kriterler

İlan, sıradan bir kimya mühendisinden çok daha fazlasını arıyor. Anthropic, bu pozisyon için şu nitelikleri öncelikli tutuyor:

Derin Uzmanlık: Kimyasal silah savunması veya patlayıcı madde üretimi alanında en az 5-8 yıl arası saha tecrübesi.

Akademik Geçmiş: Enerji materyalleri veya kimyasal harp ajanları üzerine yoğunlaşmış bir doktora derecesi.

Stratejik Bakış: "Kirli bomba" (radyolojik silahlar) gibi karmaşık tehdit senaryoları hakkında bilgi sahibi olmak ve bu bilgiyi yapay zeka güvenlik politikalarına dönüştürebilmek.

Yapay Zeka Şirketleri Neden "Silah Uzmanı" Peşinde?

Son dönemde yayınlanan raporlar, gelişmiş yapay zeka modellerinin laboratuvar ortamında tehlikeli maddelerin üretimi için adım adım talimat verebilme potansiyeline sahip olduğunu gösteriyor. Anthropic’in yanı sıra OpenAI da benzer şekilde biyolojik ve kimyasal riskler üzerine odaklanan araştırmacılar için yıllık 455.000 dolara varan maaş teklifleri sunuyor. Bu durum, yapay zeka devlerinin sadece kod yazan mühendislere değil, aynı zamanda fiziksel dünyadaki güvenlik risklerini bilen "savunma uzmanlarına" da hayati düzeyde ihtiyaç duyduğunu kanıtlıyor.

Güvenlik ve Silahlanma Tartışması

Anthropic yetkilileri, bu işe alımın şirketin "silah tasarımı" yaptığı anlamına gelmediğini, aksine "silah üretimini imkansız kılacak bariyerler" inşa etmek için yapıldığını vurguluyor. Şirket, ABD Savunma Bakanlığı (Pentagon) ile yaşadığı hukuki süreçler ve yapay zekanın askeri alanlardaki kullanımıyla ilgili etik tartışmaların tam merkezinde yer alırken, bu ilanla "sorumlu yapay zeka" markasını güçlendirmeyi hedefliyor.